Difference between revisions of "Camara Omnidireccional"

Jump to navigation

Jump to search

Frcanadillas (talk | contribs) |

Frcanadillas (talk | contribs) |

||

| (49 intermediate revisions by the same user not shown) | |||

| Line 16: | Line 16: | ||

= Progreso = | = Progreso = | ||

| + | == Elección de la cámara a utilizar == | ||

| + | * La cámara elejida para la relización de este proyecto ha sido la Surveyor Blackfin Camara. | ||

| + | :::[[File:Bfboards1.jpg|300px]] | ||

| + | |||

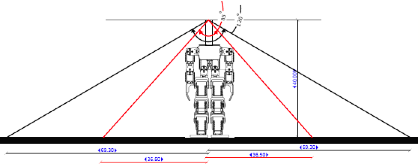

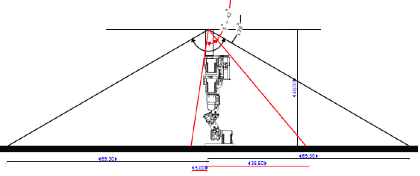

== Estudio de la configuración omnidireccional utilizada == | == Estudio de la configuración omnidireccional utilizada == | ||

| − | + | * Utililizamos la Cámara SRV-1 Blackfin con lente "fisheye". | |

| − | * Cámara SRV-1 Blackfin con lente "fisheye" | + | * Estudio del campo de visión utilizando lente "fisheye"(120º): |

| − | * Estudio del campo de visión utilizando lente "fisheye": | ||

[[File:coverageBlackfin1.png|500px]] | [[File:coverageBlackfin1.png|500px]] | ||

[[File:coverageBlackfin2.png|500px]] | [[File:coverageBlackfin2.png|500px]] | ||

| Line 30: | Line 33: | ||

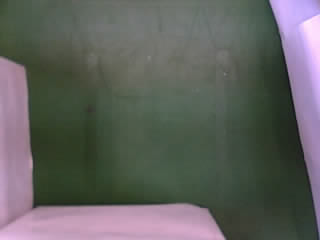

- Cálculamos la distancia entre el centro de la imagen y la frontera entre el suelo y los obstaculos, mediante la diferenciación | - Cálculamos la distancia entre el centro de la imagen y la frontera entre el suelo y los obstaculos, mediante la diferenciación | ||

de colores (blanco y verde). | de colores (blanco y verde). | ||

| − | + | [[File:Vision1.jpg]] [[File:ResulVision1.png]] | |

* '''Detección de movimiento y cálculo de este.''' | * '''Detección de movimiento y cálculo de este.''' | ||

| + | - Mediante la utilización de la teoría de la imagen diferencia calculamos el centroide del movimiento captado. | ||

| + | - Utilizando los centroides de dos imágenes diferencia generarémos el vector del movimiento captado. | ||

| + | [[File:Move0.png|160px]] [[File:Move1.png|160px]] [[File:Move2.png|160px]] [[File:ResulMove.PNG]] | ||

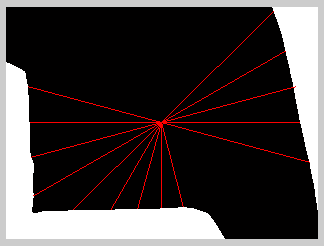

| + | * '''Cálculo del flujo óptico generado por nuestro propio movimiento.''' | ||

| + | - A causa del movimiento de nuestro robot se produce un flujo en la imagen denominado flujo óptico. | ||

| + | - Hemos utilizado la teoría del flujo óptico con brillo constante para calcular este flujo. | ||

| + | [[File:Flujo0.PNG|250px]] [[File:FlujoInt.png|300px]] | ||

| − | * | + | = Enlaces de Interés = |

| + | == Memoria del Proyecto Fin de Carrera. == | ||

| + | * Memoria del Proyecto Fin de Carrera ([[:File:PFC.pdf|PDF]]). | ||

| − | |||

== Configuraciones Omnidireccionales == | == Configuraciones Omnidireccionales == | ||

| Line 49: | Line 60: | ||

== Cámaras == | == Cámaras == | ||

| − | * [http://www.cmucam.org] | + | * CMUcam3: Open Source Programmable Embedded Color Vision Platform [http://www.cmucam.org] |

| + | |||

| + | * CMUCAM3 Sensor de visión para robot S320200 [http://www.superrobotica.com/S320200.htm] | ||

| − | * [http://www. | + | * POB-EYE II [http://www.pob-technology.com/web/index.php?page=shop.product_details&flypage=flypage-ask.tpl&product_id=99&category_id=7&option=com_virtuemart&Itemid=41&lang=en] |

| − | * [http://www. | + | * Surveyor Blackfin [http://www.surveyor.com/blackfin/] |

| − | * [http://www. | + | == Referencias de Algoritmos de Visión utilizados== |

| + | * David Cooms & Karen Roberts (1993), “Centering Behavior Using Peripheral Vision”, in proceedings of Computer Vision and Pattern Recognition (CVPR ´93),New York, pp. 440-445. [http://citeseer.ist.psu.edu/viewdoc/download;jsessionid=35726AFC8CA3D3564EC9D839339FDEBC?doi=10.1.1.55.5084&rep=rep1&type=pdf] | ||

| + | * Kahlouche Souhila and Achour Karim (2008). “Optical Flow based Robot Obstacle Avoidance”, International Journal of Advanced Robotic Systems, ISSN:1729-8806, InTech. pp. 13-16. [http://www.intechopen.com/source/pdfs/4206/InTech-Optical_flow_based_robot_obstacle_avoidance.pdf] | ||

Latest revision as of 18:53, 4 October 2012

Descripción del Proyecto

- Responsables:

- Félix Rodríguez Cañadillas (Proyecto Fin de Carrera).

- Tutor: Martin F. Stoelen.

- Director: Alberto Jardón Huete.

Objetivos

Desarollar una cámara omnidireccional de tamaño pequeño para robots mini humanoides y aeriales. Objetivos específicos:

- Integrar cámara con una configuración omnidireccional mediante espejo de forma cónica, parabólica o esférico.

- Desarollar y implementar algoritmos para evitar obstaculos.

- Desarollar y implementar algoritmos para detectar movimientos.

- Definir y implementar comunicaciones (probablamente de forma serie).

Progreso

Elección de la cámara a utilizar

- La cámara elejida para la relización de este proyecto ha sido la Surveyor Blackfin Camara.

Estudio de la configuración omnidireccional utilizada

- Utililizamos la Cámara SRV-1 Blackfin con lente "fisheye".

- Estudio del campo de visión utilizando lente "fisheye"(120º):

- Realización de un soporte e implantación de la cámara en él:

Algoritmos de visión

Desarrollo de los algoritmos de visión a través de Matlab.

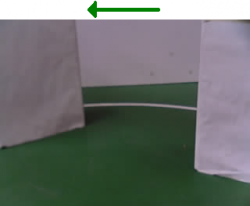

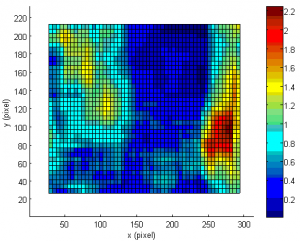

- Cálculo de la distancia a obstaculos estáticos.

- Cálculamos la distancia entre el centro de la imagen y la frontera entre el suelo y los obstaculos, mediante la diferenciación

de colores (blanco y verde).

- Detección de movimiento y cálculo de este.

- Mediante la utilización de la teoría de la imagen diferencia calculamos el centroide del movimiento captado. - Utilizando los centroides de dos imágenes diferencia generarémos el vector del movimiento captado.

- Cálculo del flujo óptico generado por nuestro propio movimiento.

- A causa del movimiento de nuestro robot se produce un flujo en la imagen denominado flujo óptico.

- Hemos utilizado la teoría del flujo óptico con brillo constante para calcular este flujo.

Enlaces de Interés

Memoria del Proyecto Fin de Carrera.

- Memoria del Proyecto Fin de Carrera (PDF).

Configuraciones Omnidireccionales

- "DIY" cámara omnidirrecional [1]

- VSTONE - cámaras omnidireccionales [2]

- Lentes "fisheye" para cámaras pequeñas [3]

- Lens Option Set for SRV-1 Blackfin Camera [4]

Cámaras

- CMUcam3: Open Source Programmable Embedded Color Vision Platform [5]

- CMUCAM3 Sensor de visión para robot S320200 [6]

- POB-EYE II [7]

- Surveyor Blackfin [8]

Referencias de Algoritmos de Visión utilizados

- David Cooms & Karen Roberts (1993), “Centering Behavior Using Peripheral Vision”, in proceedings of Computer Vision and Pattern Recognition (CVPR ´93),New York, pp. 440-445. [9]

- Kahlouche Souhila and Achour Karim (2008). “Optical Flow based Robot Obstacle Avoidance”, International Journal of Advanced Robotic Systems, ISSN:1729-8806, InTech. pp. 13-16. [10]